在 AI 发展日益迅速的今天,如何让自己的应用更智能、更高效成为了许多人关注的焦点。OpenClaw 作为一个灵活的工具,提供了与大模型结合的可能性,让开发者可以更方便地接入各种 AI 服务。在本文中,我会分享自己使用 OpenClaw 的经验,从配置 AI Provider 到管理接口 KEY,再到集成与优化的实践心得,带你一步步了解如何将 OpenClaw 与大模型无缝结合。

OpenClaw 简介

什么是 OpenClaw?

说到 OpenClaw,我个人最先想到的就是它的灵活性和可扩展性。要知道,它并不是一个普通的工具,而更像是一个桥梁,把你的应用和各种 AI 服务连接起来。换句话说,如果你想快速尝试不同的大模型,或者想在本地和云端模型之间切换,OpenClaw 能帮你省掉不少麻烦。

有意思的是,它的设计理念非常接地气,不像有些工具那样硬邦邦的,每一步配置都能清楚看到自己的操作效果。这让我在使用过程中感到非常安心,即便是新手,也能逐步摸索出自己的工作流程。

OpenClaw 的功能与优势

其实 OpenClaw 的优势,不仅仅在于连接 AI 模型。它更像一个智能管理平台,可以统一管理不同 provider 的配置,甚至还能根据环境变量自动读取接口 KEY,这一点在团队协作时尤其方便。对于我来说,最大的好处是能够同时接入云端大模型和本地推理模型,比如 OpenAI 或者 Ollama,这样就不用在多个平台之间切来切去。

另外,它的可视化配置和命令行工具也给了我很大的自由度。你可以用 CLI 设置默认的 provider 或模型,这在日常调试时节省了不少时间。总的来说,OpenClaw 让 AI 的接入不再是技术门槛,而是一种流畅的体验。

大模型与 OpenClaw 的结合

大模型概述

说到大模型,很多人脑海中浮现的可能是 ChatGPT、Claude 或者其他类似的智能助手。它们的特点就是可以处理复杂的语言任务,理解上下文,并生成自然的文本。我个人认为,大模型的魅力在于它能够弥补传统规则系统的局限,让 AI 更像一个真正“懂你”的伙伴。

不过,值得注意的是,大模型虽然强大,但也伴随着一些挑战,比如计算资源消耗大、延迟较高,或者需要合理管理接口调用和 KEY。这让我意识到,如果没有一个好的管理工具,比如 OpenClaw,这些问题可能会让开发体验变得很不顺畅。

为何选择大模型与 OpenClaw 配合

其实,这个问题没有绝对的答案,但从我的经验来看,OpenClaw 在大模型接入方面有两点特别吸引我。第一,它可以统一管理不同 provider 的配置,让你不用在每个模型的文档里反复查找;第二,它支持从环境变量读取 API Key,这意味着我可以灵活地切换环境,甚至在不同项目之间共享配置。

说到这个,顺便提一下,OpenClaw 对本地模型的支持也让我印象深刻。像 Ollama 这样的本地推理模型,完全可以无 KEY 使用,这在测试阶段尤其方便。总之,结合 OpenClaw,大模型的使用体验会顺滑得多,也减少了很多繁琐操作。

配置 AI Provider 步骤

选择合适的 AI Provider

选择 provider 时,我个人通常会先考虑用途和预算。如果是实验性项目,可能只想快速验证效果,这时 OpenAI 的云服务就很合适;如果是对数据隐私要求高的场景,本地推理模型如 Ollama 会更靠谱。值得注意的是,OpenClaw 的设计允许你同时配置多个 provider,这给了我很大的灵活性。

有意思的是,我发现不同 provider 的性能和响应风格差异很大,这让我在选择时不仅要看价格和稳定性,还得考虑输出风格是否符合项目需求。换句话说,选择 provider 并不是单纯比谁快或者便宜,而是一个综合的权衡。

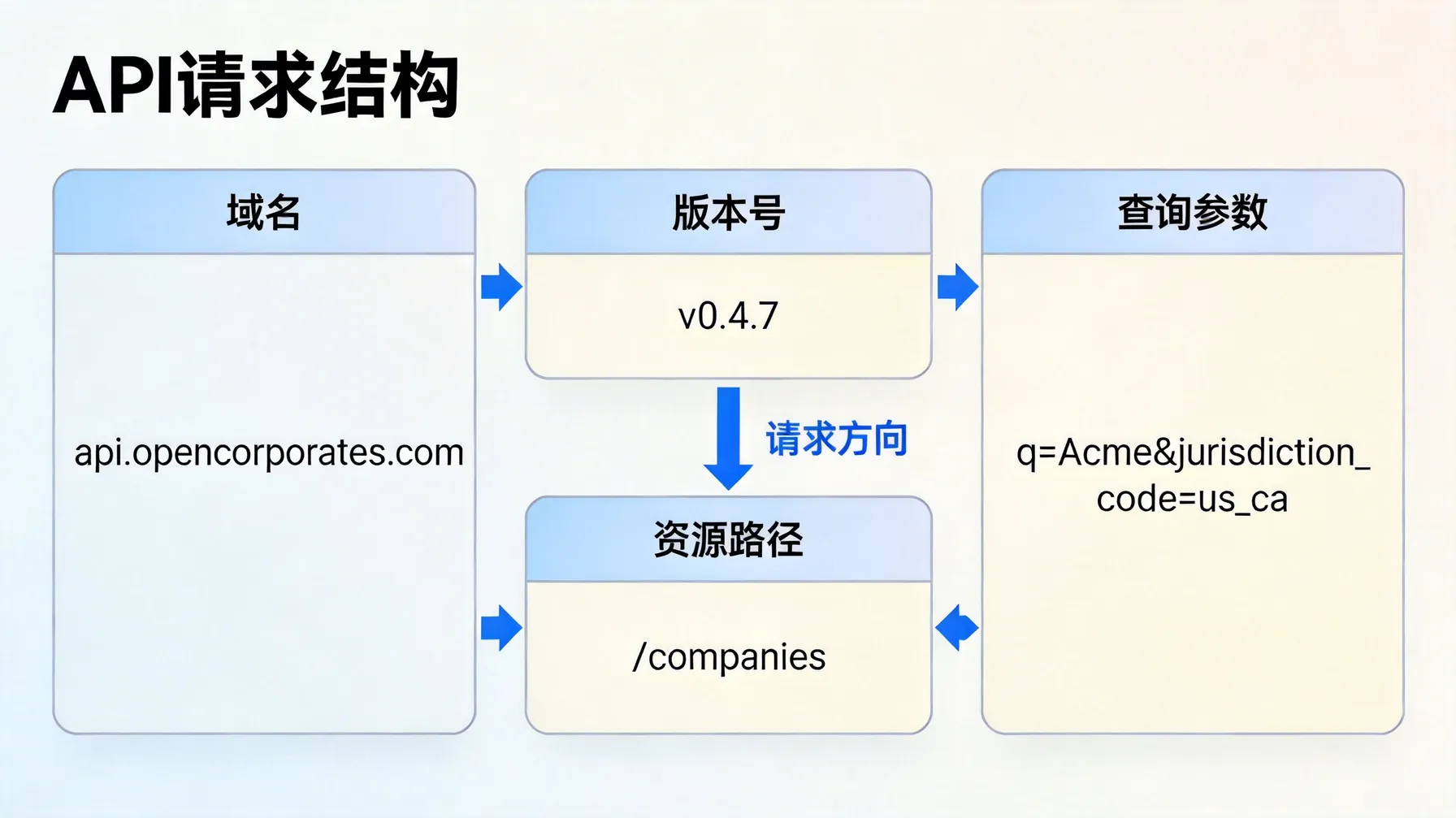

如何配置 AI Provider

在配置过程中,我通常会先打开 openclaw.json,找到 models.providers 节,然后填写 baseUrl 和 API Key。这里有一点很容易被忽略:每个 provider 都必须有自己的 baseUrl,否则 OpenClaw 根本无法识别请求。对我来说,这一步是最容易出错的,所以我会反复检查几遍。

另外,你还可以用 CLI 设置默认模型或 provider,这在切换不同任务时非常方便。我个人习惯把常用模型设置为默认,这样在日常调试时几乎不用改动配置文件,节省了不少重复操作。

常见配置问题及解决方案

这里不得不提一个小坑:很多人配置好 API Key 后,仍然会遇到连接失败的问题。根据我的观察,这通常是因为 URL 或者 KEY 格式不对。还有一种情况是本地模型的路径没配置好,这会导致 OpenClaw 找不到模型文件。遇到这些问题时,我会先用简单的请求测试连接,确认每一步都正常,再运行复杂任务。

遗憾的是,有些错误信息并不直观,所以需要一点耐心。但好在 OpenClaw 的日志足够清晰,这让我可以快速定位问题。我个人建议:每次改配置后,先做小规模测试,这样风险低,也更容易发现细节问题。

接口 KEY 配置与管理

获取接口 KEY

获取接口 KEY 其实并不复杂,但很多人会忽略安全问题。以 OpenAI 为例,你只需在控制台生成 API Key 就可以使用;而一些本地模型如 Ollama 则完全不需要 KEY,这一点非常方便。我个人在操作时会把 KEY 分别存到环境变量里,这样可以在不同项目间复用,同时避免把敏感信息写进代码。

你有没有想过,接口 KEY 的管理其实也体现了开发者对安全的态度?简单一点说,KEY 就像钥匙,放错地方很容易泄露数据,所以管理好它至关重要。

如何配置接口 KEY

配置 KEY 时,我通常会先决定是写入 openclaw.json 还是环境变量。写入配置文件方便直观,但环境变量更安全,尤其是在多人协作的情况下。我个人倾向于环境变量,这样不同机器和不同开发环境都可以灵活使用,而不用担心 KEY 泄露。

值得注意的是,OpenClaw 会自动读取环境变量里的 KEY,如果命名正确,你几乎不需要额外操作。这一点让我在项目部署时省了不少麻烦,尤其是在多环境切换时特别方便。

接口 KEY 安全管理建议

说到安全,我个人有几点小建议:一是尽量避免把 KEY 写入版本控制系统;二是使用环境变量或安全存储管理 KEY;三是定期轮换 KEY,尤其是团队合作项目。这些看似小细节,其实在长期使用中能避免很多麻烦。

虽然有点跑题,但我想补充一点:我自己在调试过程中曾经把 KEY 泄露到公共仓库,结果虽然问题及时发现,但教训非常深刻。经历过这些之后,我对安全管理有了更多直观的理解。

OpenClaw 集成与最佳实践

如何优化 AI Provider 配置

优化配置其实是一门艺术,而不是单纯的技术。我的经验是,根据任务类型选择合适的 provider,再配合默认模型设置和环境变量管理 KEY,可以大幅提高工作效率。举个例子,如果你频繁调用生成任务,我会建议把响应速度快的 provider 设置为默认,同时在 CLI 中调整参数,这样就能获得更稳定的输出。

有意思的是,这种优化不仅体现在性能上,还体现在可维护性上。一个清晰的配置,让你在团队协作时更容易理解整个系统,减少沟通成本。

OpenClaw 集成时的常见问题与解决办法

在集成过程中,我遇到过几次奇怪的报错,有时候是因为 JSON 文件格式不对,有时候是 provider 的 URL 写错。这个时候,耐心检查每一处配置是唯一的解决办法。值得注意的是,OpenClaw 的日志信息虽然不复杂,但每一条都很有用,尤其是在排查连接问题时。

另外,有些时候本地模型和云端模型混用会出现兼容性问题,我个人会先把它们分开测试,确保每一个 provider 都能独立运行,再进行联合调用。虽然步骤多一点,但省下的调试时间远远超过了这些额外操作。

附加技巧与经验分享

利用 CLI 提高效率

CLI 的强大在于可以快速切换默认模型和 provider。我个人有时候会写一些小脚本,把常用操作自动化,这样每次启动项目时几乎零操作。这让我想到,工具的灵活性有时候比功能本身更重要,因为它决定了你的工作节奏。

调试小技巧

调试时,我喜欢先用最小请求测试每个 provider,再逐步加大复杂度。这个方法虽然看似慢,但实际上可以避免很多重复错误,让整个调试过程更高效。值得一提的是,记录调试过程的日志,也会在后续迭代中帮你节省不少时间。

团队协作经验

在团队使用 OpenClaw 时,我个人觉得最重要的是保持配置的一致性。使用环境变量管理 KEY,统一配置文件模板,这些看似小事,但对协作体验有巨大的提升。顺便提一句,如果团队成员对大模型还不熟悉,写一些示例请求和结果说明也很有帮助。

本地模型的使用心得

本地模型的优势在于隐私和灵活性。我个人在处理敏感数据时,几乎全部使用本地推理模型,这样不用担心数据外泄问题。虽然本地模型可能在性能上略逊于云端,但在很多场景下,这种权衡是值得的。

未来发展思考

说到未来,我个人觉得 OpenClaw 的潜力巨大。随着大模型技术不断进步,工具本身的灵活性会越来越重要。或许将来我们能看到更多自动化配置、智能推荐 provider 的功能,这会让使用体验更加顺滑。虽然这些都是猜测,但从现在的趋势来看,确实有不少值得期待的地方。

总的来说,OpenClaw 与大模型的结合,为 AI 开发提供了一种既灵活又高效的方式。从选择 provider、配置接口 KEY,到优化集成和管理安全,每一步都值得仔细对待。我个人认为,掌握这些方法,不仅能提升工作效率,也能让开发过程更顺畅、更安全。希望这篇文章能帮你更好地理解和使用 OpenClaw,让 AI 开发变得更自然、更有趣。

常见问题

如何管理 OpenClaw 的接口 KEY?

OpenClaw 支持通过环境变量自动读取接口 KEY,方便团队协作时进行统一管理。用户也可以手动设置或修改接口 KEY。

OpenClaw 是否支持本地与云端模型的切换?

是的,OpenClaw 可以同时接入云端大模型和本地推理模型,用户可以根据需要轻松切换,减少在多个平台间的操作。

本文源自「私域神器」,发布者:siyushenqi.com,转载请注明出处:https://v.siyushenqi.com/72904.html

微信扫一扫

微信扫一扫  支付宝扫一扫

支付宝扫一扫