ChatGPT‑5 与 OpenClaw 简介

ChatGPT‑5 与 OpenClaw 简介

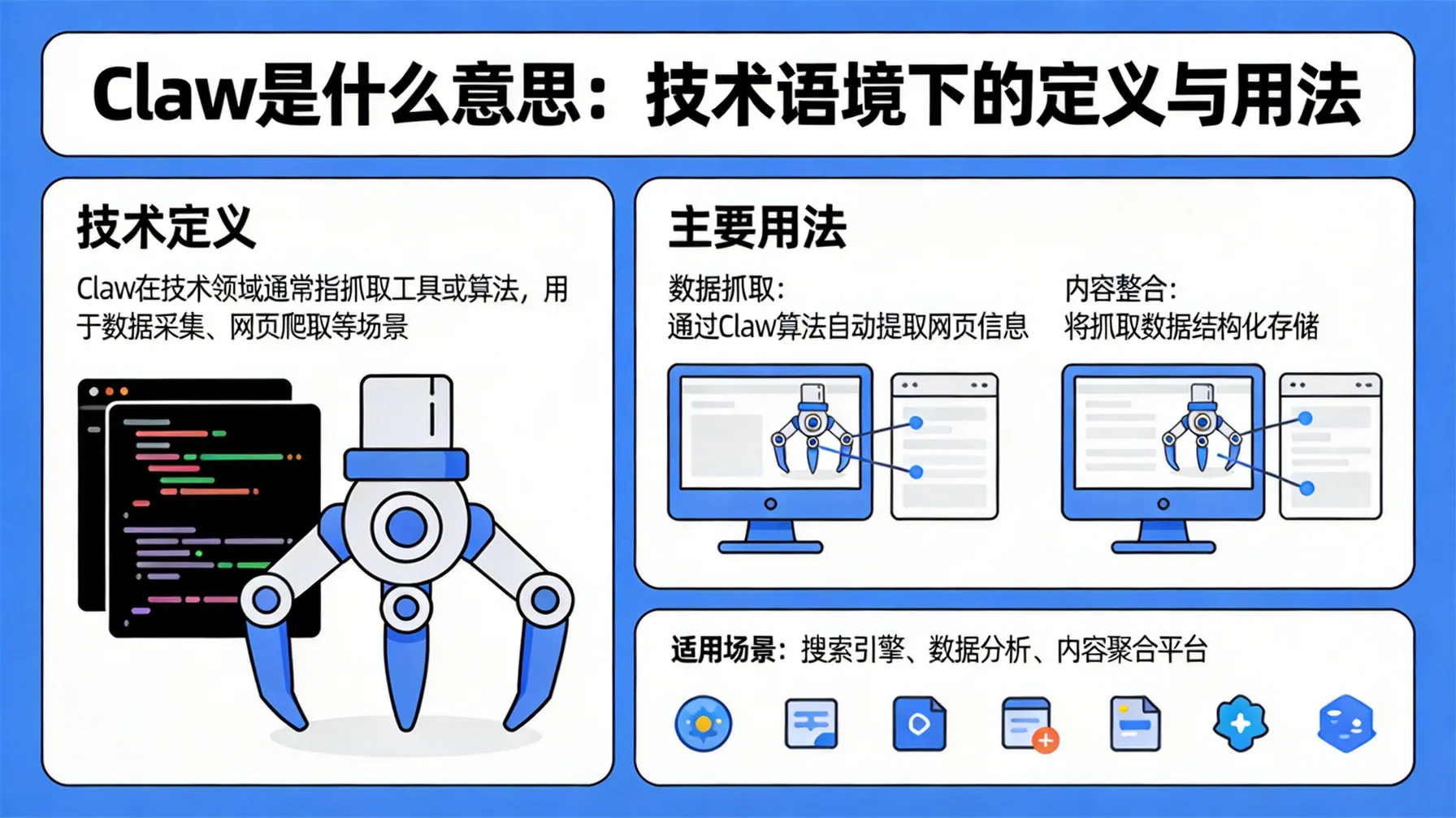

如果你跟得上人工智能的发展步伐,那么 ChatGPT-5 对你来说一定不陌生。它代表了 OpenAI 在自然语言处理领域的最新突破,具备了更加精确的语境理解能力和生成能力。而 OpenClaw 则是一款致力于提升 AI 模型集成与性能优化的工具,通过热插拔记忆与混合模型策略的创新,实现了与 ChatGPT-5 的原生支持。换句话说,OpenClaw 让 ChatGPT-5 在实际应用中的性能得到了显著提升,不仅提升了长上下文处理的稳定性,还优化了工具调用效率。

集成的重要性与应用场景

在如今这个智能化的时代,很多企业与开发者开始意识到集成 AI 模型对业务流程的深远影响。通过将 ChatGPT-5 与 OpenClaw 集成,可以为应用带来更快的响应速度、更高效的处理能力以及更稳定的长文本处理效果。比如说,在客服领域,自动化的客服系统可以通过这个集成快速处理大量客户请求,减少人工干预,同时提升服务质量。

说到这里,大家可能会问,除了客服,还有哪些场景适合这种集成呢?实际上,很多需要自然语言理解和生成的场景都可以受益于这种集成,比如智能写作、语音助手,甚至是数据分析报告的自动生成。在这些场景下,集成不仅仅是为了提升效率,更多的是帮助系统获得更强的自适应能力。

性能优化的必要性

性能优化是任何一项技术应用中不可忽视的环节,尤其是在集成 ChatGPT-5 和 OpenClaw 时。我们要知道,AI 模型虽然强大,但处理大量请求时,往往会遇到延迟、内存占用过高等问题。而 OpenClaw 提供的混合模型策略、热插拔记忆等功能,恰恰能够有效减轻这些负担,帮助开发者在提升性能的同时,控制成本,避免资源浪费。

集成前的准备工作

系统环境与依赖检查

集成 ChatGPT-5 和 OpenClaw 之前,首先要确保你的系统环境能够支持这一组合。这不仅仅是对硬件资源的需求,还包括操作系统、网络配置等多方面的考量。实际上,很多开发者在进行集成时,往往忽视了环境的适配,导致了后期的性能瓶颈。建议在开始之前,先进行一次详细的环境评估,确保一切准备就绪。

API 访问权限与认证配置

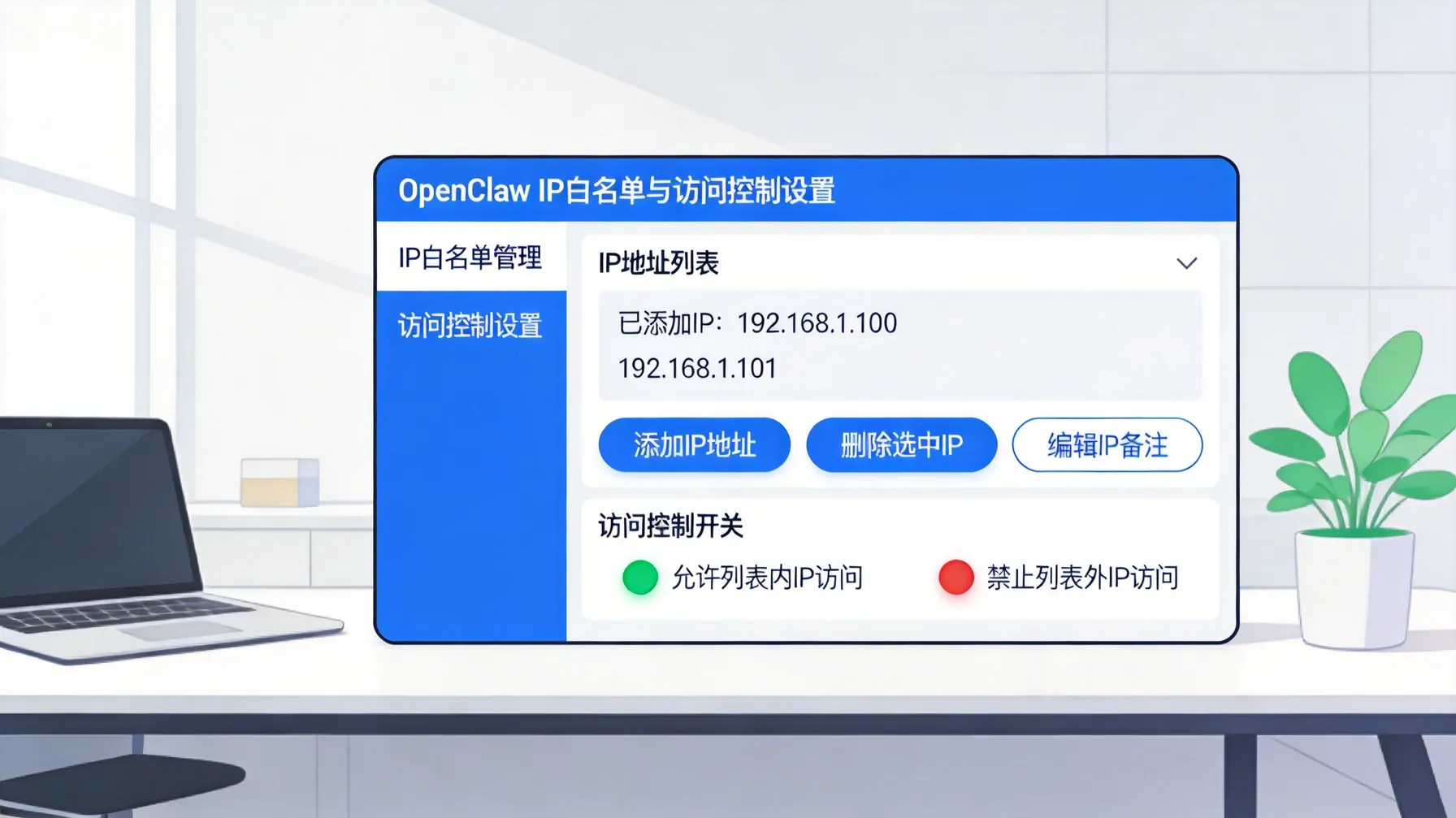

一个不容忽视的步骤是 API 的访问权限和认证配置。OpenAI 的 API 使用需要正确的 API key,而 OpenClaw 的集成也可能涉及到第三方服务的 API 认证。确保这些权限配置无误,是保证集成顺利进行的前提。值得注意的是,API 权限不足或者配置错误,可能会导致系统运行异常,进而影响到性能的稳定性。

数据结构与接口设计考虑

集成时,数据结构与接口的设计也是至关重要的部分。在 OpenClaw 和 ChatGPT-5 的集成过程中,如何合理地设计数据流、接口交互,以及如何处理请求和响应,是开发者必须深入思考的问题。以往的集成案例中,数据结构不清晰或者接口设计不合理,往往导致后期维护的困难,甚至影响到系统的稳定性。

ChatGPT‑5 与 OpenClaw 集成流程

接口调用与数据交互

集成的核心之一就是如何进行接口调用与数据交互。实际操作时,ChatGPT-5 和 OpenClaw 的数据交互需要遵循特定的协议与流程。数据从用户输入到模型处理,再到结果输出,每一环节的设计都影响着最终的性能表现。在这里,我想特别强调一个细节——API 调用的频率和方式。合理的 API 调用频率,不仅可以提高响应速度,还能在一定程度上降低服务器负载。

异常处理与日志管理

集成过程中,异常处理和日志管理也是至关重要的一环。当系统发生错误时,能够快速捕获并解决问题,是保障服务稳定运行的关键。日志管理帮助开发者追踪问题发生的根源,便于及时调整和优化。

让我分享一个经验。在一次集成过程中,我们在日志中发现了一个模型响应超时的情况,通过分析日志,最终定位到了网络配置上的问题,及时解决后,系统稳定性大大提升。

多线程与异步操作实践

在集成过程中,很多开发者会选择多线程或异步操作来优化性能。其实,这并不是一个简单的选择,而是需要根据实际需求来决定。在处理大规模请求时,异步操作能够有效提高系统的并发能力,但也需要小心避免线程安全问题。通过合理的线程池管理和任务调度,可以使整个系统运行更加高效。

性能优化策略

响应时间优化方法

在任何 AI 系统中,响应时间都是一个极其重要的指标。如何优化响应时间?首先,尽可能减少不必要的计算。其次,合理使用缓存机制,可以在一定程度上减少对模型的重复调用,从而降低响应延迟。

有意思的是,我曾经看到一些开发者使用了一种动态切换模型的方式,根据请求的复杂度来选择不同的模型进行处理。这种做法不但提升了响应速度,还有效控制了运行成本。

内存与资源管理技巧

内存和资源管理是性能优化的另一个关键环节。尤其是在处理长上下文时,系统可能会面临内存占用过高的问题。通过合理的内存管理策略,比如限制并发请求数,使用内存池等方式,可以有效减少内存浪费,提升系统的整体性能。

缓存机制与数据复用

缓存机制不仅仅是一个简单的技术问题,它还是优化系统性能的重要手段。在集成 ChatGPT-5 和 OpenClaw 时,适当的缓存策略可以大幅度提高响应速度。比如,在频繁请求同一数据时,直接从缓存中获取数据而不再进行模型计算,不仅节省了计算时间,还减少了服务器负担。

批量处理与并发优化

批量处理和并发优化是高效处理大量请求时必须考虑的策略。通过批量处理,可以有效减少请求的处理时间,同时通过合理的并发优化,避免系统过载。实际上,很多企业在进行大规模集成时,都会遇到这种挑战:如何平衡系统的负载,确保系统在高并发下也能稳定运行。

最佳实践与案例分析

成功集成案例分享

让我给大家分享一个成功的集成案例。某公司通过将 ChatGPT-5 与 OpenClaw 集成到其智能客服系统中,不仅成功提升了客户响应速度,还显著降低了系统运行成本。通过优化接口调用与缓存策略,该系统能够在几乎不增加额外硬件成本的情况下,处理成千上万的客户请求。

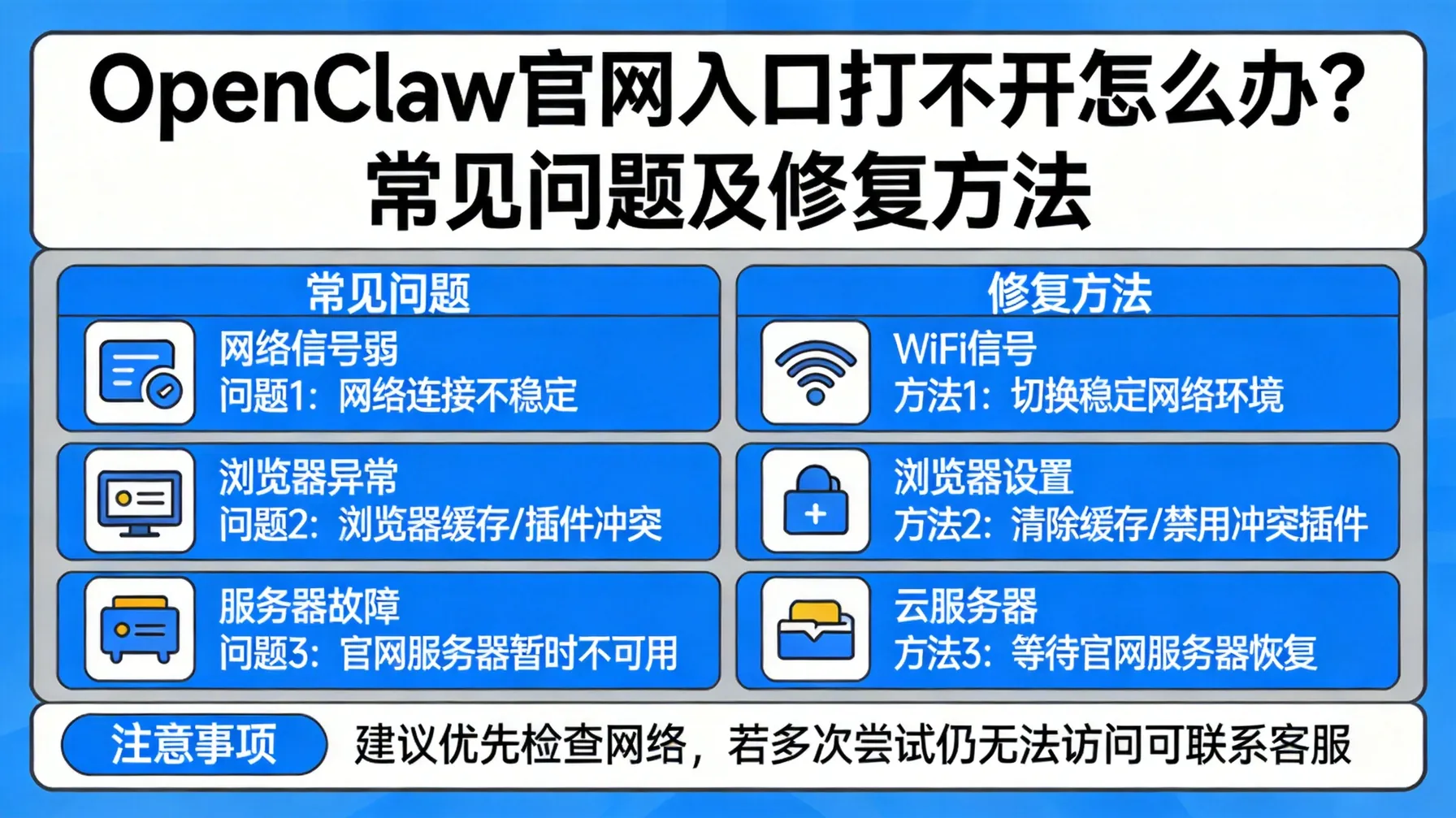

常见问题及解决方案

在集成过程中,开发者常遇到的一些问题包括 API 认证错误、模型响应超时等。幸运的是,通过合理的异常捕捉和日志管理,很多问题都能够得到及时解决。例如,模型响应超时的情况通常与网络不稳定有关,而通过优化网络配置和加速节点的部署,可以有效减缓这个问题。

持续监控与性能评估方法

集成完成之后,持续的监控和性能评估显得尤为重要。通过设置合理的性能指标,如响应时间、内存使用量等,我们可以时刻掌握系统的运行状态,及时发现潜在的问题,并进行优化。

未来发展与扩展方向

新功能与技术趋势

随着技术的不断发展,AI 集成的潜力仍然巨大。未来,我们或许能看到更多创新的技术涌现,如更智能的混合模型、更高效的内存管理技术等,这些都将极大推动 ChatGPT-5 与 OpenClaw 的应用场景拓展。

跨平台集成潜力

实际上,跨平台集成是未来发展的一个重要方向。随着各大云平台和操作系统不断更新,我们可以预见到 ChatGPT-5 和 OpenClaw 的集成,将不再局限于某一个平台,而是可以在多个平台间无缝协作。

可扩展架构设计建议

随着需求的增加,系统架构的可扩展性显得尤为重要。设计时,应该尽量采用模块化、松耦合的架构,这样可以轻松应对未来可能出现的新需求。通过合理的负载均衡与资源分配,可以确保系统的高可用性。

总结

集成与优化的关键要点回顾

通过本文的讨论,我们可以看到,ChatGPT-5 与 OpenClaw 的集成不仅仅是一个技术上的挑战,更是一次性能优化的机会。从系统环境准备,到 API 访问配置,再到实际的性能优化策略,每一个环节都需要开发者深入思考。

实施策略与实践建议

集成时,切勿忽视细节。每一步的正确执行,都能够为系统的稳定性与高效性提供保障。在实际操作中,我个人认为,做好日志管理、合理配置缓存和内存、精确监控系统性能,这些都能显著提升系统的响应速度和稳定性。

本文源自「私域神器」,发布者:siyushenqi.com,转载请注明出处:https://v.siyushenqi.com/72935.html

微信扫一扫

微信扫一扫  支付宝扫一扫

支付宝扫一扫