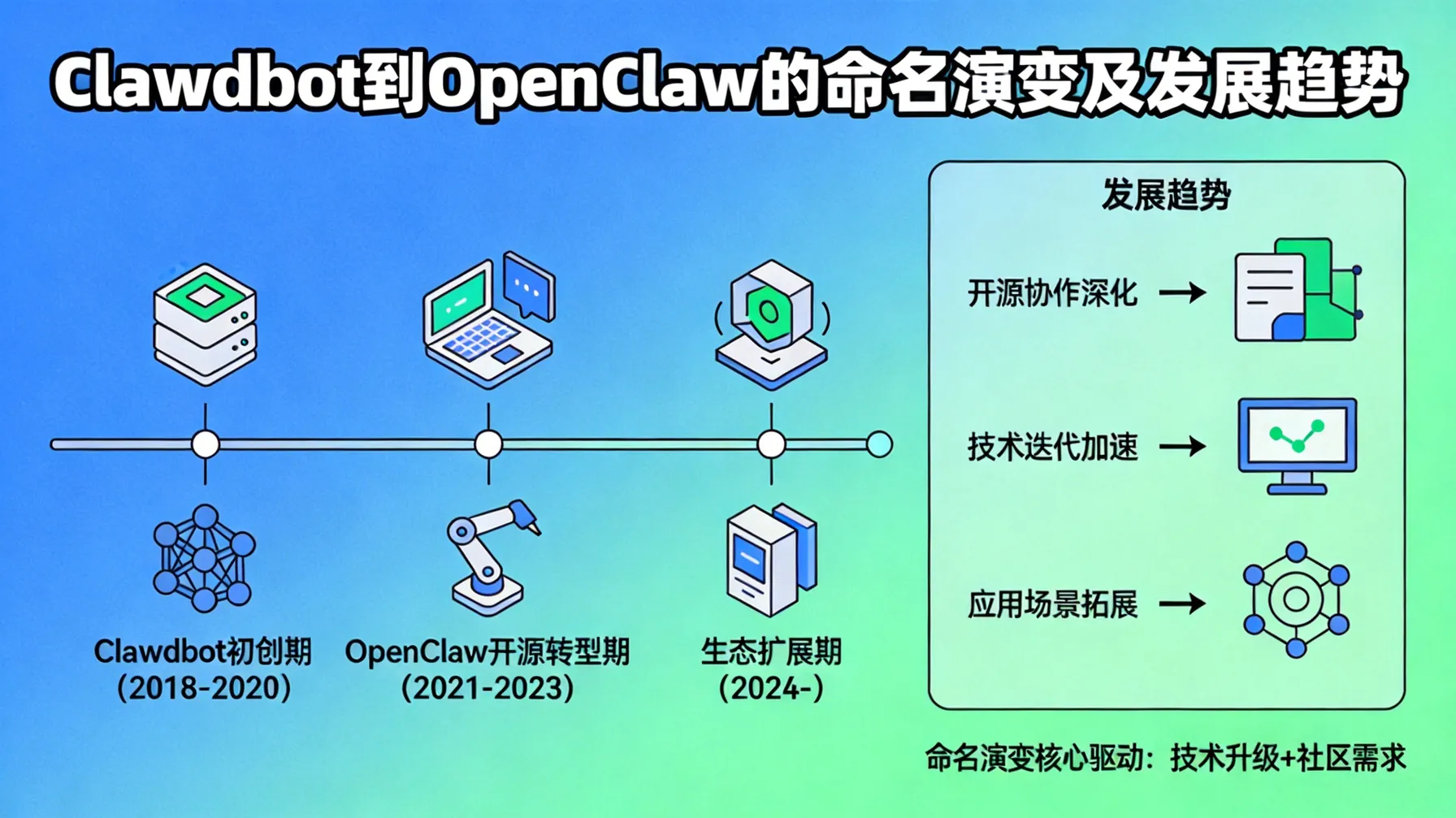

在这个 AI 工具日益丰富的时代,我发现越来越多的人开始关注如何高效地部署和使用智能助手。OpenClaw 就是这样一个特别值得关注的项目,它不仅开源,还支持多种部署方式,让我个人觉得自由度和灵活性都很高。本文将带大家从整体概览到具体资源,包括 API、镜像以及各种部署方案,一步步分析它的优缺点,并分享一些实用建议,帮助你在选择和使用 OpenClaw 时少走弯路。

OpenClaw 概述

OpenClaw 简介

说到 OpenClaw,我最先想到的是它的“自由度”。这个工具是完全开源的,MIT 许可意味着你可以免费使用、下载甚至修改。对于像我这样喜欢折腾的人来说,这种自由是非常诱人的。它不仅可以本地部署,也可以放到云端运行,甚至用 Docker 之类的容器化方式也完全没问题。

有意思的是,它还能通过 API 接入各种大语言模型,这让我想到,其实它更像一个“万能接口”,无论你是想玩免费的本地模型,还是想接入官方或第三方的 API,OpenClaw 都能兼顾。

主要功能与应用场景

我个人最喜欢 OpenClaw 的一点是它的灵活性。你可以用它搭建个人助手,或者集成到现有应用中提供智能化服务。换句话说,它既适合技术爱好者,也能被企业用户利用。举个例子,我曾经尝试用它做一个小型聊天机器人实验,结果发现 API 接入非常顺畅,而且可以同时调试本地模型,节约了不少成本。

值得注意的是,它不仅支持文字交互,还可以通过 HTTP API 暴露服务,这就意味着你可以在不同平台、不同应用之间共享 AI 能力。说白了,你可以把它想象成一个桥梁,把各种模型和你的应用轻松连接起来。

为什么选择 OpenClaw

你可能会问,为什么不直接用某个付费云服务呢?我觉得原因很简单:成本和可控性。OpenClaw 的开源特性意味着你可以完全掌控自己的数据和部署环境,不必担心隐私泄露或者高昂的订阅费用。虽然有点跑题,但我个人在使用其他付费 API 时,常常会为请求次数或者价格纠结,这种烦恼在 OpenClaw 里几乎不存在。

此外,社区活跃也是一个大加分项。官方和社区都提供了丰富的教程和镜像资源,让入门门槛比我想象中低很多。我自己在试验本地模型的时候,按照教程一步步操作,竟然也能顺利跑起来。

OpenClaw 免费 API 资源

官方免费 API 介绍

谈到 API,OpenClaw 的官方接口让我印象深刻。虽然我不是每天都用官方 API,但偶尔需要快速验证模型效果时,它显得特别方便。官方 API 支持多种模型,文档相对完整,即使是第一次接触的人,也能快速上手。

顺便提一下,这种官方接口的优势在于稳定性高。你不用担心镜像版本不兼容,或者部署出现奇怪的问题——官方的通常都是经过测试的版本。

第三方免费 API 列表

当然,除了官方,还有不少第三方提供免费 API。我个人在尝试过程中发现,这类资源虽然五花八门,但也充满不确定性。有的接口响应速度很快,有的则可能偶尔断线。使用时需要根据具体需求来选择,或者多准备几个备选方案。对我来说,这种“多管齐下”的策略比单一依赖某一个 API 更安心。

API 使用限制与注意事项

说到限制,这里还是要提醒一下。大部分免费 API 都会有请求次数或者速率限制,所以你得提前规划调用策略。还有一点,我个人觉得容易被忽略:接口稳定性。免费的服务难免偶尔中断,尤其在流量高峰期,所以在设计应用时最好加上容错逻辑。

OpenClaw 镜像资源

官方镜像下载渠道

谈到镜像,我第一时间会想到官方渠道。官方镜像一般都是最新版本,兼容性和安全性都更有保障。个人经验告诉我,直接用官方镜像往往少踩坑,而且升级也更顺畅。不过,需要注意的是,下载速度可能会受网络影响,如果碰到慢的情况,可以考虑用国内镜像加速。

社区镜像及其优缺点

社区镜像则有趣得多。它们有时会加入一些官方没有的功能或者预配置好的环境,这对我这种喜欢尝鲜的人来说很吸引。不过,遗憾的是稳定性不一定有保证。有一次我用社区镜像跑实验,结果某些依赖版本不兼容,差点把整个环境搞崩。总之,社区镜像适合测试或者临时使用,而不是生产环境首选。

镜像使用与更新策略

关于镜像更新,我个人的做法是:尽量保持官方版本,社区镜像作为补充。每次更新前,我会先在测试环境跑一遍,确认没有大问题再迁移到正式环境。这个步骤虽然有点麻烦,但省得后续花时间修复意外问题,值得投资时间。

OpenClaw 部署方案对比

本地部署方案

我个人觉得本地部署最直观,也是控制感最强的方式。你可以完全掌握数据和运行环境,哪怕是离线状态也能使用。不过,缺点也明显:需要一定的硬件资源和技术基础。对于我这种平时喜欢折腾电脑的人来说,本地部署是个乐趣,但对新手可能稍显复杂。

云端部署方案

云端部署则省心很多。你不用担心本地环境配置,只要有网络就能使用。让我印象深刻的是,云端部署可以随时扩展算力,尤其在实验大模型时,体验感明显好很多。缺点嘛,成本上可能比本地高一点,而且要考虑数据安全性。

Docker 与容器化部署

至于 Docker,我个人几乎每次部署都会用。它的优势在于环境一致性和迁移方便。说到这个,我想起上次用 Docker 快速部署了一个测试环境,整个流程比我预想的顺利多了。而且,一旦镜像做好,别人拿去就能直接运行,这种“开箱即用”的体验真的很棒。

性能与成本对比

性能和成本总是要权衡。我个人观察到,本地部署初期成本高(硬件投入),长期来看,如果频繁调用大模型,可能比云端便宜;而云端部署初期几乎零投入,但长期使用可能费用累积很快。这个问题没有简单答案,得根据使用频率和算力需求灵活选择。

OpenClaw 免费资源使用建议

选择合适 API 与镜像策略

在我看来,API 与镜像的选择要结合实际需求。比如,如果只是轻量实验,我会倾向用官方免费 API;如果需要长时间稳定运行,官方镜像加本地部署或 Docker 是更安全的选择。值得一提的是,灵活切换 API 与本地模型也能节省不少成本。

部署方案优化建议

部署时,我个人建议先在测试环境摸清楚每种方案的优缺点,再做正式部署。比如 Docker 可以作为过渡方案,既不用破坏本地环境,也能保证迁移方便。这个过程中多试多调,总能找到最适合自己的组合。

常见问题与解决方法

用 OpenClaw 的过程中,我常碰到的问题主要是依赖版本冲突和 API 限制。解决方法嘛,其实不复杂:提前做好环境隔离、备份镜像、设置容错机制。这个经验让我觉得,事先花时间规划,总比遇到问题临时救火省心多了。

总结与资源汇总

免费资源清单

整理下来,OpenClaw 的免费资源还是挺丰富的:官方 API、第三方 API、官方镜像、社区镜像、本地模型和 Docker 部署镜像。我个人会把它们分成“实验用”和“生产用”,这样在选择时更有针对性。

最佳实践推荐

至于最佳实践,我的经验是:稳定性优先,灵活性辅助。官方资源尽量用,社区镜像适合测试;Docker 容器化可以保证环境一致;API 调用要注意速率限制和容错处理。虽然每个人的需求不同,但遵循这些原则,基本可以少踩坑,多享受探索的乐趣。

总的来说,OpenClaw 不仅开源自由,而且资源丰富,灵活度高。我个人觉得,它适合从初学者到技术爱好者,再到企业用户不同层次的人群使用。希望通过本文的介绍,你能更清楚地理解它的价值,并找到适合自己的部署和使用方案,让 AI 助手真正服务于日常工作和创意实验。

常见问题

使用 OpenClaw 是否需要付费?

OpenClaw 遵循 MIT 许可,免费提供下载、使用和修改,无需订阅费用。

本文源自「私域神器」,发布者:siyushenqi.com,转载请注明出处:https://v.siyushenqi.com/72902.html

微信扫一扫

微信扫一扫  支付宝扫一扫

支付宝扫一扫